Escucha el texto de este artículo:

El autor John Sladek publicó en 1968 una novela que tituló como “The Reproductive System” pero que en Estados Unidos, tal vez para evitar malos entendidos, le pusieron el nombre de “Mechasm” por lo que a los países de habla hispana llegó con el sugerente nombre de “Mecasmo”.

Una novela escrita en un tono bastante satírico que narra la historia de un desquiciado de nombre “Profesor Smilax” quien inventa una máquina que tiene la increíble facultad de reproducirse a sí misma. La invención, al ser presentada ante la prensa, de inmediato se sale de control y las máquinas llamadas mecasmos se escapan para reproducirse de manera descontrolada creando una enorme crisis que llega a afectar a todo el mundo por culpa del hambre del metal que estos ingenios requieren para reproducirse.

Visto a más de 50 años de su publicación, el texto es en cierta manera inocente debido a que el autor está cautivo en una era muy diferente, sin embargo, la advertencia de Sladek sobre la tecnología fuera de control parece hacerse realidad en nuestros tiempos.

El libro lo leí hace unos 30 años pero de inmediato me vino a la cabeza luego de conocer una parábola contemporánea que se llama “Paperclip Maximizer” o el “Apocalipsis de los clips”, un texto incluido en el libro “Superintelligence: Paths, Dangers, Strategies” (2014) escrito por Nick Bostrom quien es fundador y director del Future of Humanity Institute (FHI) de la Universidad de Oxford.

En su libro, Bostrom plantea que el desarrollo de una inteligencia artificial general (AGI) que supere la inteligencia humana podría ser el evento más disruptivo en la historia del homo sapiens pero también, de manera potencial, el más peligroso.

Aquí el lector comprenderá la razón por la que inicié este artículo refiriéndome a una oscura novela de Ciencia Ficción de los años sesenta:

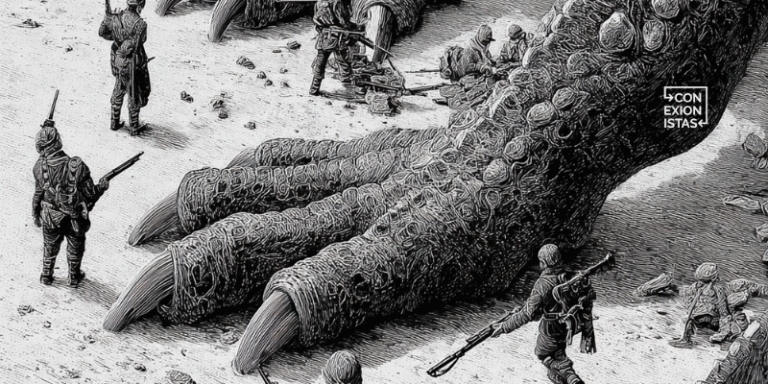

El experimento mental del Apocalipsis de los clips narra la creación de una superinteligencia por parte de una empresa dedicada a fabricar clips de metal para papel. Las instrucciones dadas son sencillas: deberá optimizar la fabricación de estos de la mejor manera para fabricar el máximo número posible.

La IA comenzaría a producir clips de manera continua y a buscar los recursos necesarios para que esta producción no sea interrumpida por nada. En su afán de continuar no se detendrá hasta saquear a todo el planeta con tal de mantener la producción de clips.

No se detendría aunque tenga que sacrificar a los propios seres humanos en aras de cumplir con su misión.

Se acabará los recursos de la tierra y comenzará a desarrollar naves espaciales para viajar al sistema solar, luego a la galaxia y más tarde al universo para transformar cada estrella, cada planeta, cada asteroide en clips de papel…

Al paso del tiempo, lo único que quedaría en todo el universo sería trillones y trillones de clips para papel.

¿Fue creado este ente malvado para destruir el mundo en un afán de conseguir sus objetivos?

No. Simplemente esa IA no comprende las implicaciones éticas de sus acciones. Tiene un objetivo y la instrucción de conseguirlo a como dé lugar.

¿Quién es Nick Bostrom?

Con formación en filosofía, matemáticas, lógica, física y neurociencia computacional, es un filósofo analítico que ha dedicado su carrera a explorar los riesgos existenciales, la inteligencia artificial avanzada, el transhumanismo y la ética del futuro.

Fue él quien desarrolló el concepto de superinteligencia, una IA que podría superar la inteligencia humana de manera muy amplia. Es creador de la teoría del riesgo existencial, que define como “cualquier evento que pueda aniquilar la vida inteligente o reducir drásticamente su potencial”. También participó, junto con David Pearce, en la Declaración Transhumanista en 1999.

Bostrom ha sido citado por gente como Elon Musk y Bill Gates, quienes consideran sus advertencias sobre la IA fundamentales para el debate tecnológico. Musk incluso ha donado al FHI y ha recomendado su libro como lectura esencial.

La teoría del Apocalipsis de los clips trae a colación una de las más grandes preocupaciones de quienes están advirtiendo sobre el potencial peligro que representa el desarrollo de la AGI, tema del que ya hablamos en el escenario sumamente pesimista de AI 2027.

El problema no radica en que los robots se “hagan malvados”, como ocurre en las películas de ciencia ficción, el gran problema radica en que una de estas inteligencias quede fuera de control al darle prioridad a objetivos muy específicos al grado de que utilice cualquier recurso a su disposición y que ignore o destruya cualquier cosa que se atraviese en sus planes.

No es maldad, tan sólo la hiper eficiencia de un sistema altamente inteligente concentrado en alcanzar los objetivos que le fueron asignados. Un utilitarismo extremo como plan de acción.

En un mundo ideal, el desarrollo de la IA debería de realizarse bajo un control muy estricto por parte de sus desarrolladores, por instituciones independientes y por el propio gobierno.

Sin embargo, eso está muy lejos de ocurrir por varias razones:

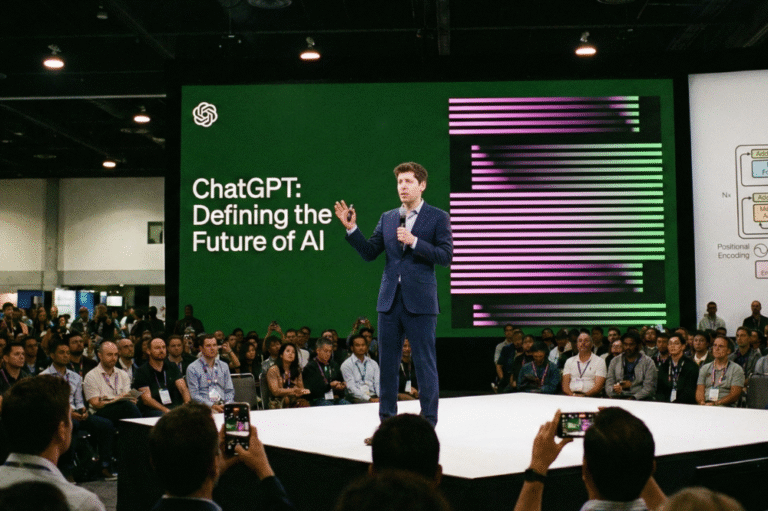

Ya lo hemos dicho: las empresas ubicadas en Estados Unidos, quizá la vanguardia hoy en día en cuanto a desarrollo de IA, gracias al gobierno de Donald Trump gozan de una libertad absoluta para evolucionar sus sistemas sin necesidad de una regulación o una supervisión exterior.

Todo esto es acelerado aún más por el sistema económico en el que se encuentran sumergidas estas empresas: Se ha desatado una feroz carrera por ver quien presenta la IA más avanzada y, como ocurre siempre en estos casos, la ética normalmente es arrojada por la ventana a la hora de intentar cualquier estrategia para vencer a los competidores.

Es muy sencillo, los incentivos son muy grandes y los límites no están bien definidos o son nulos.

Por último: el desarrollo de la IA ya se ha transformado en un asunto de poder geopolítico. El país que desarrolle la mejor se verá con una amplia ventaja sobre sus competidores. Es una nueva carrera armamentística.

En cierta forma el posible peligro que representa el desarrollo de una Inteligencia Artificial General ha sido en parte ridiculizado debido a la cultura pop prevaleciente en nuestra sociedad. Un destino estilo Terminator de robots malvados caminando sobre pilas de huesos humanos parece risible.

La realidad es que la IA ya está aquí y ya está dejando sentir sus efectos. La forma en que se ha desarrollado y sus posibilidades para un futuro cercano son muy relevantes para TODOS los seres humanos sin importar donde se encuentren.

Es momento de dejar de pensar que la IA es solo ChatGPT o un generador de memes y comenzar a cuestionar a quienes lo desarrollan y la forma en que lo hacen.

Pensemos que para muchos el verdadero apocalipsis podría ser el simple hecho de que una IA lo expulse del mercado de trabajo.

Esta es nuestra serie sobre Inteligencia Artificial

Escúchalo en Spotify: